微軟研發MR+機器人框架

基于HoloLens實現機器人操控交互

在過去的數十年間,工程師不斷為我們帶來功能和性能越來越先進的技術,比方說“空間計算”。

空間計算是指計算機、機器人和其他電子設備“感知”周圍環境并創建其數字表示的能力,而混合現實等尖端技術可以顯著增強空間計算,并幫助創建復雜的傳感和測繪系統。

日前,微軟混合現實與人工智能實驗室(Microsoft Mixed Reality and AI Lab)和蘇黎世理工學院的研究人員提出了一種將混合現實和機器人技術結合起來,以增強空間計算應用的框架。

能夠感知周圍環境并以數字方式表示的空間計算為人機交互提供了全新的能力。特別是,在混合現實設備結合空間計算和Egocentric Sensing自我中心感知可允許系統捕獲和理解人類行為,并將其轉化為具有空間意義的行為。

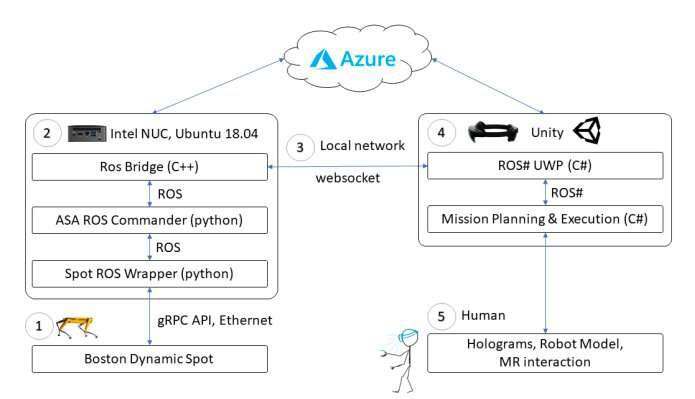

所以在名為《Spatial Computing and Intuitive Interaction: Bringing Mixed Reality and Robotics Together》的論文中,團隊提出了基于上述理念的三個機器人用例系統:檢查任務規劃;基于手勢的控制;以及沉浸式遠程操作。

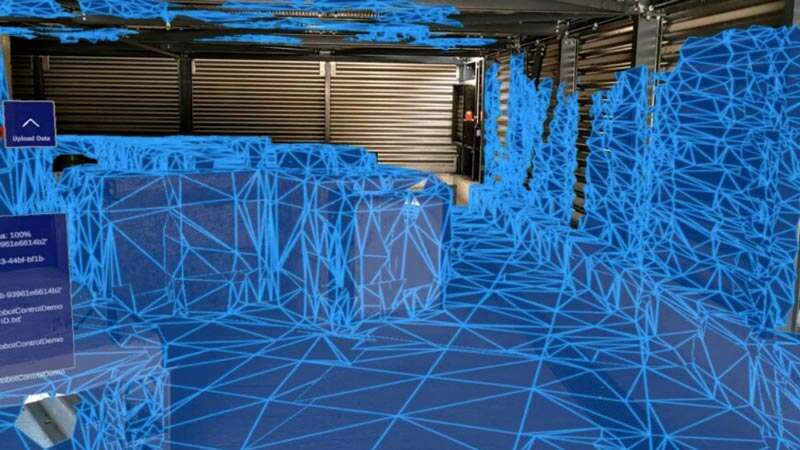

第一個系統設計用于規劃需要檢查給定環境的機器人任務。基本上,人類用戶穿戴HoloLens在目標環境中移動,放置全息圖,形成定義機器人軌跡的航路點。另外,用戶可以突出顯示希望機器人收集圖像或數據的特定區域。相關信息經過整理后,就可以在機器人檢查環境時用以指導它的動作和行動。

團隊創建的第一個系統將HoloLens映射轉換為二維占用網格表示,坐標框架與網格對齊,以便通過激光雷達實現機器人定位。

第二個系統是一個基于手勢的控制界面。其中,人類用戶可以通過HoloLens來有效地與機器人交互,使用手勢來操作機器人完成一系列的動作。研究人員指出,設備的共同定位允許它們各自能夠將自己定位到一個共同的參考坐標系。基于它們相對于所述公共坐標系的單獨姿勢,可以計算本地化設備之間的相對變換,并隨后用于實現設備之間的新行為和協作。

為了實現設備的共定位,團隊引入了一個旨在確保系統中的所有設備都共享彼此位置和一個公共參考映射的映射。用戶只需執行一系列直觀的手勢,就可以使用HoloLens頭顯為機器人提供導航指示。

第三個系統主要用于沉浸式遠程操作,這意味著用戶可以在利用機器人的“眼睛”來查看感知機器人周圍環境,并且遠程控制機器人。對于這個系統,原理與上述介紹類似,遠程機器人可以將攝像頭視圖傳送回HoloLens,并在設備用戶的視場投射相關的視圖。這時,HoloLens可以將用戶的操作指令發回給機器人,并致使其執行一系列的操作。

對于需要機器人在人類無法進入的環境中導航的情景,這種系統將特別具有價值。

研究人員解釋道:“我們探索用戶動作向遠程機器人的投射,以及機器人空間感知向用戶的投射。我們考慮了多個層次的沉浸感,基于觸控和操縱實際機器人的模型來視線控制,以及更高級別的沉浸,亦即將用戶的運動直接映射到機器人,令用戶‘變成’機器人。”

在最初的測試中,所述三個系統都取得了非常具有前景的實驗結果。當然,團隊坦誠未來依然需要進一步的優化和測試。但這項實驗突出了通過MR+機器人來增強空間計算和人機交互的潛力。未來,所述系統可以應用到眾多不同的環境,幫助人類與機器人進行密切協作,從而有效地解決更廣泛的復雜現實問題。

相關論文:Spatial Computing and Intuitive Interaction: Bringing Mixed Reality and Robotics Together

團隊最后表示:“所述研究展示了混合現實作為人機交互工具的力量,以及空間計算和混合現實推動人機交互未來的潛力。”

?